- 方法gydF4y2Ba

- 开放获取gydF4y2Ba

- 发表:gydF4y2Ba

基于深度生成模型的半监督COVID-19 CT图像分割gydF4y2Ba

BMC生物信息学gydF4y2Ba体积gydF4y2Ba23gydF4y2Ba,文章号:gydF4y2Ba343gydF4y2Ba(gydF4y2Ba2022gydF4y2Ba)gydF4y2Ba

摘要gydF4y2Ba

背景gydF4y2Ba

图像分割中一个反复出现的问题是缺乏标记数据。在对2019冠状病毒病(COVID-19)患者进行肺CT分割时,这一问题尤其严重。原因很简单:这种疾病流行的时间还不够长,不足以产生大量的标签。半监督学习提供了一种从无标签数据中学习的方法,近年来已经取得了巨大的进步。然而,由于其标签空间的复杂性,这些进步不能应用于图像分割。话虽如此,同样的复杂性使得获取像素级标签的成本极高,这使得半监督学习更具吸引力。本研究旨在通过提出一种新的模型来弥补这一差距,该模型利用深度卷积网络的图像分割能力和生成模型的半监督学习能力来处理COVID-19患者的胸部CT图像。gydF4y2Ba

结果gydF4y2Ba

我们提出了一种新的生成模型,称为共享变分自编码器(SVAE)。SVAE利用潜在变量的五层深层层次结构和它们之间的深度卷积映射,从而生成非常适合肺部CT图像的生成模型。然后,我们在SVAE的最后一层添加了一个新的组件,该组件迫使模型使用必须与地面真相分割相匹配的分割来重建输入图像。我们将这个最终模型命名为“缝合网”。gydF4y2Ba

结论gydF4y2Ba

我们将StitchNet与来自COVID-19患者的高质量CT图像数据集上的其他图像分割模型进行了比较。我们表明,我们的模型具有可比的性能,以其他分割模型。我们还探讨了我们提出的算法的潜在局限性和优势,并针对这一具有挑战性的问题提出了一些潜在的未来研究方向。gydF4y2Ba

背景gydF4y2Ba

现代基于深度学习的图像分割技术往往需要大量的像素级标签才能有效。然而,为了获得这些标签,有必要让人坐下来对图像中的每个像素进行分类。这需要大量的人力。就生物医学图像而言,通常需要一个专家小组来进行标记,这使得情况变得更糟。因此,任何有可能减少所需标签图像数量的技术都具有巨大的价值。gydF4y2Ba

这一问题可以在怀疑患有2019冠状病毒病(COVID-19)的患者的诊断和预后中看到,使用肺部的计算机断层扫描(CT)扫描。对这些扫描图像进行像素级分割,识别健康组织以及受普通肺炎或新型冠状病毒肺炎影响的肺部部分,可以成为诊断以及确定患者目前或将面临多大风险的有力工具。然而,获取这些分割对于医疗专业人员来说是非常耗时的手工操作。针对这一问题,有一些研究[gydF4y2Ba1gydF4y2Ba,gydF4y2Ba2gydF4y2Ba,gydF4y2Ba3.gydF4y2Ba使用深度学习模型进行图像分割,使这一过程自动化。尽管存在大量的CT图像数据集,但这些模型只能在由熟练的放射科医生手工标记的CT图像上进行训练,这严重限制了可用数据的数量。gydF4y2Ba

半监督学习有可能缓解这个问题。半监督模型能够同时从无标签和有标签的图像中学习,大大减少了实现令人满意的性能所需的有标签图像的数量。出于这个原因,近年来对半监督学习的研究出现了激增。我们将讨论以前在图像分割方面的一些重要工作,从几个完全监督模型开始,然后是几个半监督模型。gydF4y2Ba

U-Net [gydF4y2Ba4gydF4y2Ba]是一种基于深度学习的图像分割模型,在医学图像任务中取得了巨大成功。它利用编码器-解码器风格的架构,在编码器和解码器之间有跳过连接。SegNet [gydF4y2Ba5gydF4y2Ba]有一个类似的编码器-解码器风格的架构,但是它在解码器中使用最大的解池层而不是跳过连接。MobileNetV2 [gydF4y2Ba6gydF4y2Ba,一个图像分类网络,可以作为U-Net的编码器。与更大的编码器网络相比,MobileNetV2的性能仅略差,但速度要快得多。张等。[gydF4y2Ba1gydF4y2Ba]使用了几种基于深度学习的监督分割模型[gydF4y2Ba4gydF4y2Ba,gydF4y2Ba5gydF4y2Ba,gydF4y2Ba7gydF4y2Ba来预测病人肺部CT图像的分割。范等。[gydF4y2Ba3.gydF4y2Ba]和陈等人。[gydF4y2Ba8gydF4y2Ba]都提出了新颖的监督分割模型,这些模型已经手工制作,在胸部CT图像上表现良好。虽然令人印象深刻,但这些模型仍然受到带有像素级标签的CT图像数量的限制。gydF4y2Ba

远离完全监督模型,有大量的论文提出了使用图像级标签作为图像分割任务的监督信号的深度学习模型。他们gydF4y2Ba不gydF4y2Ba利用完全没有标签的图像。这项任务有时被称为纯粹的或真正的半监督,很少有已发表的论文涉及它[gydF4y2Ba9gydF4y2Ba,gydF4y2Ba10gydF4y2Ba,gydF4y2Ba11gydF4y2Ba,gydF4y2Ba12gydF4y2Ba,gydF4y2Ba13gydF4y2Ba,gydF4y2Ba14gydF4y2Ba,gydF4y2Ba15gydF4y2Ba,gydF4y2Ba16gydF4y2Ba,gydF4y2Ba17gydF4y2Ba,gydF4y2Ba18gydF4y2Ba,gydF4y2Ba19gydF4y2Ba].gydF4y2Ba

上述纯半监督模型倾向于使用某种形式的对抗训练、自我训练、聚类或多视图训练来解决问题。许多论文[gydF4y2Ba10gydF4y2Ba,gydF4y2Ba13gydF4y2Ba,gydF4y2Ba16gydF4y2Ba,gydF4y2Ba18gydF4y2Ba,gydF4y2Ba19gydF4y2Ba]使用对抗训练的鉴别器深度卷积网络来确保某些分割模型的预测是真实的。这个方案允许他们利用这样一个事实,即即使你不知道地面真相,它至少应该属于与标记图像的地面真相相同的分布,从而在未标记的照片上训练他们的网络。这种技术的主要缺点是很难让具有对抗成分的模型收敛到解决方案。gydF4y2Ba

其他文件[gydF4y2Ba9gydF4y2Ba,gydF4y2Ba14gydF4y2Ba]使用这样一个事实,即被一些基于深度学习的无监督聚类算法确定为相似的图像(标记或未标记)也应该在各种潜在空间和特征空间中彼此接近。这些技术依赖于如何定义“接近”,这对于像图像这样高维的数据来说是相当困难的,导致这些模型的性能不佳。gydF4y2Ba

Pseudo-labelling [gydF4y2Ba20.gydF4y2Ba是一种常用的半监督学习技术,其中训练一个完全监督的深度网络,然后用于对一些未标记的数据做出预测。然后使用模型最自信的预测作为标签对网络进行重新训练。然而,如果这种预测的质量很低,那么该方案将不断强化这种不良行为,造成灾难性的后果。因此,伪标签通常被认为是最不有效,但最简单的半监督技术。有几篇论文[gydF4y2Ba3.gydF4y2Ba,gydF4y2Ba12gydF4y2Ba],他们在做了一些重大修改后使用了这个通用方案。gydF4y2Ba

与这篇论文一样,许多论文[gydF4y2Ba2gydF4y2Ba,gydF4y2Ba3.gydF4y2Ba]试图利用COVID-19患者的未标记CT图像。Shan等人[gydF4y2Ba2gydF4y2Ba)采用一种有趣的“人在圈中”策略。该策略需要在一个基于像素标记数据的小数据集上训练一个基于深度学习的分割网络,然后使用该网络在一个大型未标记数据集上进行预测。然后,这些预测由熟练的放射科医生改进,并包括在像素级标记数据集中。网络被重新训练,这个过程重复,直到达到满意的性能。尽管标记工作大大减少,但这种技术仍然需要一些手工标记工作,许多研究小组将简单地gydF4y2Ba不gydF4y2Ba有机会接触放射科医生。gydF4y2Ba

范等。[gydF4y2Ba3.gydF4y2Ba)使用最基本的伪标签。尽管如此,与完全监督的基线相比,他们在分割性能上取得了相当大的增长。这使得采用更复杂的半监督技术非常有动力,因为伪标签远远不能充分利用这些未标记的图像。冯等人。[gydF4y2Ba21gydF4y2Ba]提出了一个这样做的模型。他们在Fan等人的InfNet模型中添加了一个自我监督的预训练步骤。在这一步中,CT图像被一个黑色矩形遮挡,并训练模型重建完整的CT图像。虽然这种方法能够改进InfNet,但它分为两个单独的步骤进行训练,并且可以端到端训练的半监督技术可能会进一步提高性能。gydF4y2Ba

深度生成模型为半监督模型提供了一个优雅的框架。从本质上讲,他们将图像和标签视为图形模型中的两个随机变量,并试图使用变分推理的最新进展对两者进行建模。一些著名的例子是M2变分自编码器[gydF4y2Ba22gydF4y2Ba]和辅助深度生成模型[gydF4y2Ba23gydF4y2Ba].不幸的是,这方面的绝大多数研究都是在图像分类领域,其中标签只是每张图像的单个类别。可以假设这些类别中的每一种发生的可能性是相等的。即使这个假设非常接近现实,它仍然允许容易计算,封闭形式的计算。现代基于深度生成的半监督技术很大程度上依赖于这一事实。gydF4y2Ba

一个类似的假设gydF4y2Ba不能gydF4y2Ba在图像分割的情况下进行。这有几个关键原因。首先,因为gydF4y2Ba每一个gydF4y2Ba像素有一个标签,唯一的分割的数量是指数大于唯一的图像级标签的数量。此外,这些独特的分割很少是现实的。例如,一组像素,已经给gydF4y2Ba狗gydF4y2Ba标签但都是人的形状是不现实的分割。这很重要,因为它完全消除了我们假设每个独特的分割都有相同可能性发生的能力。最后,每个像素的标签严重依赖于图像中其他像素的标签,从而消除了做出任何独立假设的可能性。由于这些原因,现代半监督技术在用于图像分割时往往会失败。gydF4y2Ba

上述问题虽然有问题,但并不新鲜。在试图找到能够对图像建模的分布时也遇到了同样的问题。变分法[gydF4y2Ba24gydF4y2Ba,gydF4y2Ba25gydF4y2Ba]通过找到图像的潜在表示以及基于深度学习的图像与其潜在表示之间的功能映射来处理这个问题。然后,你可以自由地对潜在空间的分布进行简化假设,而无需对图像的分布进行任何假设。在本研究中,我们通过寻找原始CT图像及其分割的潜在表示来利用这种方法。因为我们希望我们的模型即使在不存在ground-truth分割的情况下也能学习分割图像,我们假设原始CT图像依赖于分割。通过这样做,在没有ground-truth分割的情况下,模型学习预测对原始CT图像重建有用的分割。gydF4y2Ba

原变分自编码器(VAE) [gydF4y2Ba24gydF4y2Ba]可以用于这项任务,但它缺乏足够的表达能力来对大型数据集进行建模。当数据集是图像之一时尤其如此。阶梯变分自动编码器(LVAE) [gydF4y2Ba26gydF4y2Ba通过引入潜变量的层次结构和训练这种层次结构的新方法,极大地提高了VAE的表现力。在这项研究中,我们通过在推理和生成网络中共享几个关键权重来修改LVAE。此外,我们用深度卷积网络替换LVAE中的所有函数映射,这些网络已经手工制作,可以很好地处理CT图像。我们将得到的模型命名为gydF4y2Ba共享变分自动编码器gydF4y2Ba(SVAE)。gydF4y2Ba

在它们的原始形式中,VAE、LVAE和SVAE被设计为将图像作为输入,并将图像重建为输出。我们修改SVAE输出一个分割掩码和四个CT图像,每个分割标签一个。然后,对原始CT图像进行重建gydF4y2Ba缝合gydF4y2Ba将基于分割的四幅CT图像拼接在一起。我们命名结果模型gydF4y2BaStitchNetgydF4y2Ba.总之,我们开发了一个新的深度生成模型,称为SVAE。然后,使用SVAE,我们创建了一个名为StitchNet的半监督模型,并在来自COVID-19患者的高质量CT图像数据集上进行测试。gydF4y2Ba

结果gydF4y2Ba

数据集gydF4y2Ba

对于StitchNet的评价,Zhang等人[gydF4y2Ba1gydF4y2Ba使用中国胸部CT图像调查协会(CC-CCII),并进行了一些修改。CC-CCII包含2778例患者的CT图像,共计444034张图像。85%的患者来自中国宜昌、合肥或广州,其余来自国际队列。这些患者要么患有普通肺炎(CP),要么患有新型冠状病毒肺炎(NCP),要么属于对照组。在我们的数据集中,我们排除了CP患者。gydF4y2Ba

CC-CCII包含750个分割掩码,对应150例NCP患者。分割由五名拥有超过25年经验的高级放射科医生完成。他们划分了三个标签:健康肺域、磨玻璃影和实变。gydF4y2Ba

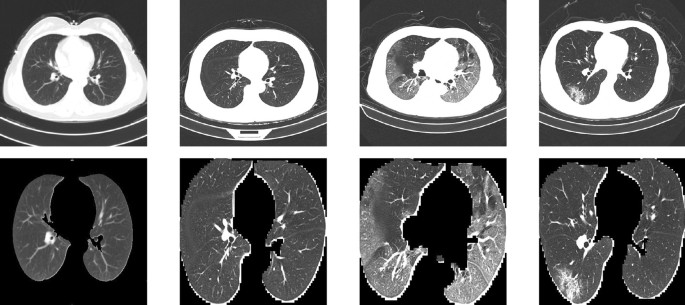

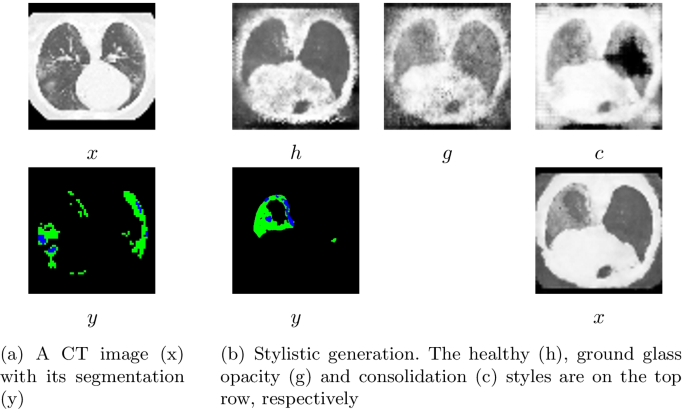

现在我们将讨论我们采用的数据预处理和清洗程序。我们使用U-Net语义分割模型对每个CT图像中的肺野进行分割。采用开闭形态学变换进行降噪。然后将图像裁剪为只包括肺野。结果如图所示。gydF4y2Ba1gydF4y2Ba.在我们的模型中使用之前,所有图像都被调整到352的分辨率gydF4y2Ba⨯gydF4y2Ba352,像素值被缩放到0到1之间。我们随机将60%的标记数据分为训练集,20%分为测试集和20%的验证集。我们是按病人而不是按图像来做的,这样一个病人的所有CT图像都将恰好在三个集合中的一个,从而避免了数据泄漏。gydF4y2Ba

评价指标gydF4y2Ba

对于每张图像,我们采用以下四个评估指标:交叉-联合,F1-Score,召回率和精度。gydF4y2Ba

(1)gydF4y2Ba欠条(IoU)gydF4y2Ba:交集-over- union用于测量地面真实感染区域(T)与预测感染区域(P)之间的重叠,并控制感染区域的大小。gydF4y2Ba

(2)gydF4y2BaF1- score (F1)gydF4y2Ba: F1-Score,也称为骰子系数,用于衡量地面真实感染区域(T)与预测感染区域(P)之间的重叠。gydF4y2Ba

(3)gydF4y2Ba回忆(Rec)。gydF4y2Ba:召回,也称为灵敏度或真阳性率,用于衡量实际感染区域(T)在预测感染区域(P)中存在的比例。gydF4y2Ba

(4)gydF4y2Ba精密(Prec。)gydF4y2Ba: Precision用于测量预测感染区域(P)在ground-truth感染区域(T)中所占的比例。这四个指标定义在式(gydF4y2Ba1gydF4y2Ba).gydF4y2Ba

在哪里gydF4y2Ba\(|\,\,\,|\)gydF4y2Ba是计算给定区域内像素数的运算符,gydF4y2Ba\ \)(\帽gydF4y2Ba是交集算子,和gydF4y2Ba\杯子(\ \)gydF4y2Ba是联合运算符。gydF4y2Ba

我们计算每个CT图像的上述指标,并平均结果。的gydF4y2Ba的意思是gydF4y2Ba而且gydF4y2Ba标准偏差(STD)gydF4y2Ba定义如下:gydF4y2Ba

让gydF4y2Ba米gydF4y2Ba((gydF4y2BaxgydF4y2Ba,gydF4y2BaygydF4y2Ba))为为该数据点计算的相关评价指标的值(gydF4y2BaxgydF4y2Ba,gydF4y2BaygydF4y2Ba).然后让gydF4y2Ba文本\({\{度量}}= \ {M ((x_i y_i)) \} _ {(x_i y_i)} \在D_ {Val} \)gydF4y2Ba,在那里gydF4y2Ba\ (D_ {Val} \)gydF4y2Ba是验证数据集。gydF4y2Ba

(1)gydF4y2Ba的意思是gydF4y2Ba:然后gydF4y2Ba的意思是gydF4y2Ba仅仅是gydF4y2Ba\(\暗流{{\文本{度量}}}{总和\}\压裂{M ((x_i y_i))}{|{\文本{度量}}|}\)gydF4y2Ba.gydF4y2Ba

(2)gydF4y2Ba性病gydF4y2Ba:性病是gydF4y2Ba\ \√{\压裂{1}{|{\文本{度量}}|}\暗流{{\文本{度量}}}{\总和}(M ((x_i y_i)) - \μ)^ 2}\)gydF4y2Ba,在那里gydF4y2Ba\μ(\ \)gydF4y2Ba是均值。gydF4y2Ba

性能比较gydF4y2Ba

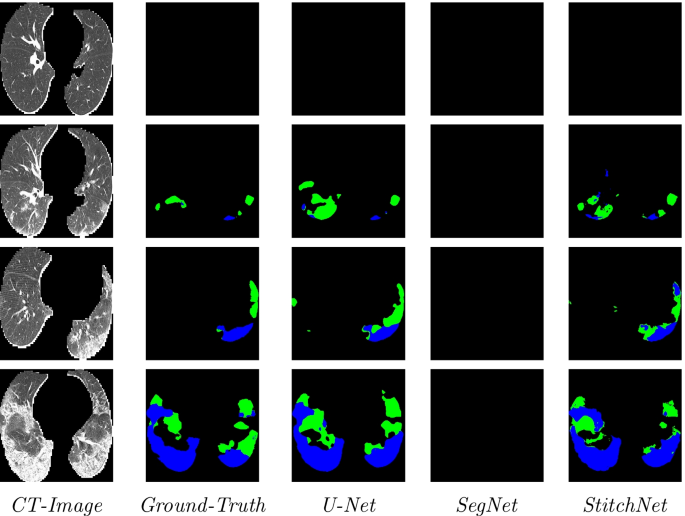

我们将StitchNet与SegNet和U-Net与MobileNetV2编码器进行了比较。用于训练StitchNet的超参数可以在附加文件中找到gydF4y2Ba1gydF4y2Ba:表S1。测试集的结果如表所示gydF4y2Ba1gydF4y2Ba并给出了图中所示的实例预测。gydF4y2Ba2gydF4y2Ba.验证和训练集的结果可以在附加文件中找到gydF4y2Ba1gydF4y2Ba:表S2和表S3。虽然在预测磨砂玻璃不透明度标签时,StitchNet和U-Net的性能具有可比性,但StitchNet的精度更高,而U-Net的召回率更高。这似乎表明,与U-Net相比,StitchNet的预测更为保守。SegNet不能预测任何病变,只能预测背景类。这可能是由于其骨干网基于过时的VGG16网络[gydF4y2Ba27gydF4y2Ba],而StitchNet和U-Net的主干网使用更复杂的MobileNetV2。gydF4y2Ba

讨论gydF4y2Ba

对于磨玻璃样混浊和实变病变,StitchNet的表现与完全监督U-Net模型相当。这表明,StitchNet正在从有标签的数据中学习,而不是没有标签的数据。当只对标记数据进行训练时,StitchNet预测出与适当病变明显相关的样式,有效地让您看到如果CT图像完全被相关病变填充会是什么样子。正因为如此,StitchNet在标记数据上的表现似乎完全符合预期。当只对未标记的数据进行训练时,StitchNet学习独特而有意义的风格,学习有意义的数据聚类。这正是我们在没有标签数据的训练中所期望的。gydF4y2Ba

基于这两个观察结果,当对标记和未标记数据进行训练时,StitchNet应该学会预测与病变相关的风格,例如gydF4y2Ba这两个gydF4y2Ba标记数据gydF4y2Ba而且gydF4y2Ba未标记的数据。StitchNet在有标签的数据上实现了这一点,然而,在没有标签的数据上,所有的风格都是相同的,每张图像的分割都是完全相同的。这似乎表明,基本的想法是合理的,但在StitchNet能够超越监督网络之前,还需要做进一步的工作。gydF4y2Ba

此外,我们注意到,StitchNet模型的标准差始终低于U-Net模型。这是因为模型能够通过对未标记数据的训练来加强对标记数据的预测,从而使模型在未标记数据上的表现更加一致。gydF4y2Ba

结论gydF4y2Ba

总之,我们提出了一种新的生成模型,称为共享变分自编码器(SVAE),通过在编码器和解码器之间引入共享权重,为生成建模领域做出了理论贡献。我们使用该模型提出了StitchNet,该模型能够解决半监督CT图像分割的挑战性任务。虽然缝合网的理论基础是健全的,但在充分利用未标记数据之前,还需要进一步的工作。gydF4y2Ba

方法gydF4y2Ba

共享变分自动编码器gydF4y2Ba

在本节中,我们将介绍的理论,实现和优化gydF4y2BaSVAEgydF4y2Ba.假设我们有一个数据集,gydF4y2Ba\(D = \{x^{(i)}\}_{i = 0}^{N-1}\)gydF4y2Ba的,gydF4y2BaNgydF4y2Ba图像。假设这些图像是独立和同分布的(i.i.d)。来自真实分布的样本,gydF4y2BapgydF4y2Ba(gydF4y2BaxgydF4y2Ba),我们希望近似该真实值分布。这允许我们从近似中取样,合成新的图像。阶梯变分自动编码器[gydF4y2Ba26gydF4y2Ba]是最近提出的一个模型,该模型已被证明对这种分布建模非常有效。在这里,我们将简要总结他们的工作,并讨论一些潜在的问题。LVAE假设数据是在分层抽样过程中生成的。具体来说,它假设,为了生成图像,我们首先从单位高斯分布潜变量中取一个样本,gydF4y2Ba\ (z_n \)gydF4y2Ba.然后对该样本应用一个函数,将参数输出到对角高斯分布潜变量,gydF4y2Ba\ (z_ {n} \)gydF4y2Ba.这将重复n层,最后一个输出分布是图像中每个像素的分布(他们的工作使用伯努利分布)。这允许他们假设在潜在变量条件下像素之间的独立性。该模型表示为gydF4y2Ba\(θp_ \ \)gydF4y2Ba.gydF4y2Ba

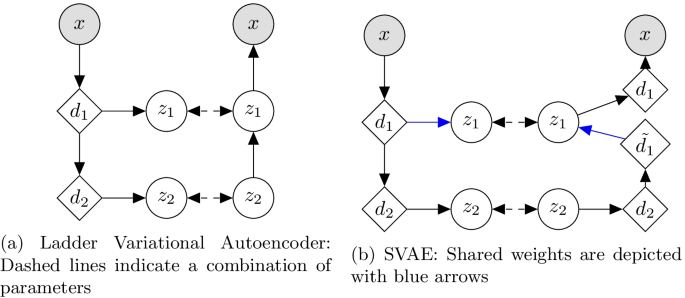

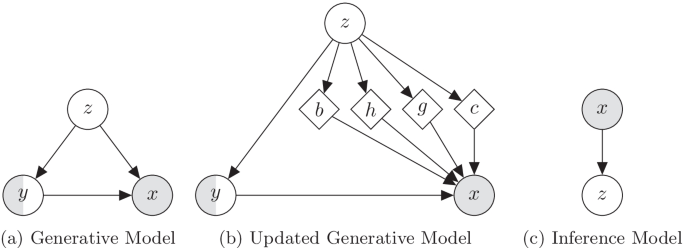

LVAE使用变分推理来学习这两个模型gydF4y2Ba\(θp_ \ \)gydF4y2Ba和一个近似的后gydF4y2Ba\(θp_ \ \)gydF4y2Ba,gydF4y2Baφ\ (q_ \ \)gydF4y2Ba.在之前的研究中,gydF4y2Baφ\ (q_ \ \)gydF4y2Ba将推断出的值gydF4y2Ba\ (z_1 \)gydF4y2Ba从gydF4y2BaxgydF4y2Ba而且gydF4y2Ba\ (z_2 \)gydF4y2Ba从gydF4y2Ba\ (z_1 \)gydF4y2Ba.LVAE的不同之处在于gydF4y2Baφ\ (q_ \ \)gydF4y2Ba完成一次确定的向下传递,然后每一次gydF4y2BazgydF4y2Ba是从这个向下通道的中间层推断出来的。通过将潜在变量的推断分布参数与生成模型的预测分布参数相结合,恢复潜在变量之间的依赖关系。如图所示。gydF4y2Ba3.gydF4y2Ba一个。gydF4y2Ba

尽管LVAE非常有趣,但它的设计并不能很好地处理大型、复杂的数据集,如CT图像。在这项研究中,我们试图修改LVAE,使其在这样的数据集上工作得很好。我们通过将LVAE中潜在变量之间的映射替换为深度卷积层来实现这一点,这些深度卷积层已经手工制作,可以在CT图像上很好地工作。现在,为了找到gydF4y2Ba\ (z_1 \)gydF4y2Ba鉴于gydF4y2Ba\ (z_2 \)gydF4y2Ba,我们应用反卷积层gydF4y2Ba\ (d_2 \)gydF4y2Ba得到gydF4y2Ba\ (d_1 \)gydF4y2Ba然后应用很多卷积层gydF4y2Ba\ (d_1 \)gydF4y2Ba得到gydF4y2Ba\ (z_1 \)gydF4y2Ba.我们注意到,两者都是如此gydF4y2Ba\(θp_ \ \)gydF4y2Ba而且gydF4y2Baφ\ (q_ \ \)gydF4y2Ba,我们有一个映射gydF4y2Ba\ (d_n \)gydF4y2Ba而且gydF4y2Ba\ (z_n \)gydF4y2Ba.我们假设这种映射在两者中具有完全相同的目的,并且同时拥有两个共享权重将提高性能。有了这最后的变化,我们到达gydF4y2Ba共享变分自动编码器gydF4y2Ba(如图所示。gydF4y2Ba3.gydF4y2Bab)gydF4y2Ba

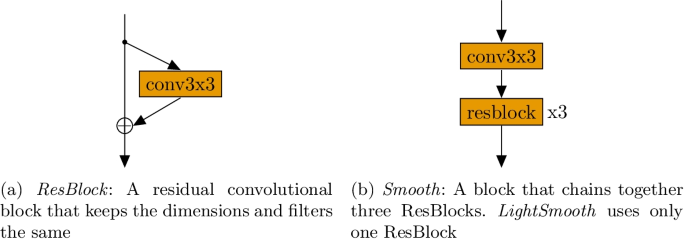

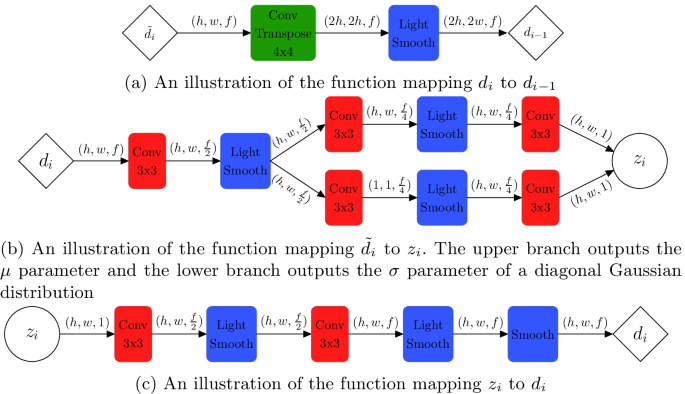

在这里,我们将描述SVAE模型中使用的深度卷积层。图中描述了该模型的几个构建模块。gydF4y2Ba4gydF4y2Ba.当滤波器数量大于64时,线性瓶颈卷积[gydF4y2Ba28gydF4y2Ba]来代替传统的卷积。批处理归一化[gydF4y2Ba29gydF4y2Ba]然后是ReLU [gydF4y2Ba30.gydF4y2Ba]激活跟随每个卷积层,并为了清晰而被抑制。SVAE有五层潜在变量,与图中描述的两层相反。gydF4y2Ba3.gydF4y2Bab.这些潜变量的维数及其确定性展开如表所示gydF4y2Ba2gydF4y2Ba.我们使用的中间层和输出层gydF4y2BaMobileNetV2gydF4y2Ba[gydF4y2Ba28gydF4y2Ba]用图像,gydF4y2BaxgydF4y2Ba,作为获取的输入gydF4y2Ba\ (d_1、d_2…d_5 \)gydF4y2Ba.变量之间的映射如图所示。gydF4y2Ba5gydF4y2Ba.gydF4y2Ba

StitchNetgydF4y2Ba

在本节中,我们将介绍的理论,实现和优化gydF4y2BaStitchNetgydF4y2Ba.假设我们有一个数据集,gydF4y2Ba\(D_{UN} = \{(x^{(i)})\}_{i=0}^{N-1}\)gydF4y2Ba的,gydF4y2BaNgydF4y2BaCT图像,其中gydF4y2Ba\ (x ^ {(i)} \)gydF4y2Ba表示gydF4y2Ba\ (^ {th} \)gydF4y2Ba数据集中的CT图像。我们假设gydF4y2Ba\ (x ^ {(i)} \)gydF4y2Ba是一个高维向量,其分量范围为0到1。假设我们有一个数据集,gydF4y2Ba\(D_{LAB} = \{(x^{(i)},y^{(i)})\}_{i=0}^{M-1}\)gydF4y2Ba的,gydF4y2Ba米gydF4y2BaCT图像及其相关分割,gydF4y2Ba\ (y ^ {(i)} \)gydF4y2Ba.我们假设gydF4y2Ba\ (y ^ {(i)} \)gydF4y2Ba是相同的维度gydF4y2Ba\ (x ^ {(i)} \)gydF4y2Ba并且有属于集合的元素gydF4y2Ba\(\{0、1、2、3 \}\)gydF4y2Ba.这里,如果gydF4y2Ba\ (n ^ {th} \)gydF4y2Ba条目的gydF4y2Ba\ (y ^ {(i)} \)gydF4y2Ba等于0,那么这表明gydF4y2Ba\ (n ^ {th} \)gydF4y2Ba条目的gydF4y2Ba\ (x ^ {(i)} \)gydF4y2Ba为CT图像背景的一部分,其中1、2、3分别对应健康组织、磨玻璃混浊和实变级别。如图所示。gydF4y2Ba6gydF4y2Ba一个。gydF4y2Ba

我们希望获得一个能够拍摄CT图像的模型(gydF4y2BaxgydF4y2Ba),并输出精确的分段(gydF4y2BaygydF4y2Ba).换句话说,我们希望接近基本事实gydF4y2BapgydF4y2Ba(gydF4y2BaxgydF4y2Ba|gydF4y2BaygydF4y2Ba)条件分布。虽然不是这些术语的典型措辞,但监督式深度学习技术通过对该分布引入以下近似来做到这一点:gydF4y2Ba

在哪里gydF4y2Ba\(文本{猫}}{\ \)gydF4y2Ba是分类分布,gydF4y2Ba\ (f \θ\)gydF4y2Ba是一个复函数。由于他们在图像数据上的巨大成功,gydF4y2Ba\ (f \θ\)gydF4y2Ba通常被选为卷积神经网络。gydF4y2Ba

这些监督技术的目标是找到参数gydF4y2Ba\θ(\ \)gydF4y2Ba这最好地解释了我们得到的数据。这是通过使用数值逼近算法(如梯度下降)最大化以下目标来实现的:gydF4y2Ba

这样说,这些监督技术的缺点是显而易见的。他们只能使用标记的数据集gydF4y2Ba实验室\ (D_ {} \)gydF4y2Ba.为了解决这个问题,不要近似gydF4y2BapgydF4y2Ba(gydF4y2BaygydF4y2Ba|gydF4y2BaxgydF4y2Ba),我们可以建立联合分配模型gydF4y2BapgydF4y2Ba(gydF4y2BaxgydF4y2Ba,gydF4y2BaygydF4y2Ba),并推导出条件分布gydF4y2BapgydF4y2Ba(gydF4y2BaygydF4y2Ba|gydF4y2BaxgydF4y2Ba)。这使得我们可以同时使用,gydF4y2Ba实验室\ (D_ {} \)gydF4y2Ba而且gydF4y2Ba联合国\ (D_ {} \)gydF4y2Ba通过治疗gydF4y2BaygydF4y2Ba作为后一种情况下的潜在变量。gydF4y2Ba

为了有效地建模gydF4y2BapgydF4y2Ba(gydF4y2BaxgydF4y2Ba,gydF4y2BaygydF4y2Ba),我们会假设gydF4y2BaxgydF4y2Ba而且gydF4y2BaygydF4y2Ba依赖于来自SVAE的潜在变量的层次结构,这里我们将简单地表示为gydF4y2BazgydF4y2Ba.现在我们来建模gydF4y2BapgydF4y2Ba(gydF4y2BaxgydF4y2Ba,gydF4y2BaygydF4y2Ba,gydF4y2BazgydF4y2Ba).此外,我们将假设每个数据点,gydF4y2Ba\ ((x ^ {(i)}, y ^ {(i)}, z ^ {(i)}) \)gydF4y2Ba,以以下方式生成:gydF4y2Ba

在哪里gydF4y2BapgydF4y2Ba(gydF4y2BazgydF4y2Ba)假设服从SVAE和的分布gydF4y2Ba\(p_\theta (\cdot)\)gydF4y2Ba假设是一个参数化的分布gydF4y2Ba\θ(\ \)gydF4y2Ba(如图所示。gydF4y2Ba7gydF4y2Ba).gydF4y2Ba

生成gydF4y2BaxgydF4y2Ba我们将首先生成四种风格表示,它们被称为gydF4y2BabgydF4y2Ba,gydF4y2BahgydF4y2Ba,gydF4y2BaggydF4y2Ba而且gydF4y2BacgydF4y2Ba-gydF4y2BaxgydF4y2Ba.这些风格的表现gydF4y2BaxgydF4y2Ba向你展示如果整个肺是背景,健康,毛玻璃影和实变,图像会是什么样子。然后我们重建gydF4y2BaxgydF4y2Ba通过从与所预测的标签相关联的样式中选择像素gydF4y2BaygydF4y2Ba.这些风格的例子如图所示。gydF4y2Ba6gydF4y2Bab。gydF4y2Ba

我们将使用这个定义以及下面的定义来定义gydF4y2Ba\(θp_ \ \)gydF4y2Ba:gydF4y2Ba

其中BETA表示BETA分布gydF4y2Ba\(\alpha _\theta (z)\)gydF4y2Ba而且gydF4y2Ba\(\beta _\theta (z)\)gydF4y2Ba一些复杂函数的参数是gydF4y2Ba\θ(\ \)gydF4y2Ba它输出beta分布的参数。gydF4y2Ba

最后我们定义gydF4y2Ba\(θp_ \ \)gydF4y2Ba作为gydF4y2Ba

在哪里gydF4y2Ba\(\pi _\theta (z)\)gydF4y2Ba复函数的参数是什么gydF4y2Ba\θ(\ \)gydF4y2Ba.我们现在有一个生成模型,非常适合CT图像分割(如图所示)。gydF4y2Ba7gydF4y2Bab, c)。剩下的是概述一种求值的有效方法gydF4y2Ba\θ(\ \)gydF4y2Ba这最好地解释了我们观测到的数据。具体来说,我们希望解决gydF4y2Ba

潜变量的存在,推而广之,对它们进行积分的需要,使得这个目标完全难以解决。的对数似然度上优化一个变分下界gydF4y2Ba\(θp_ \ \)gydF4y2Ba.具体来说,我们优化,gydF4y2Ba

虽然gydF4y2Baφ\ (q_ \ \)gydF4y2Ba可以是任何潜在变量的函数,这个下界正好等于真实的对数似然什么时候gydF4y2Baφ\ (q_ \ \)gydF4y2Ba等于gydF4y2Baθ\ (p_ \ \)gydF4y2Ba后,gydF4y2Ba\ (p_ \θ(z | x, y) \)gydF4y2Ba.因此,gydF4y2Baφ\ (q_ \ \)gydF4y2Ba有一种近似于后验的解释。当我们实现gydF4y2Baφ\ (q_ \ \)gydF4y2Ba我们会牢记这一事实。gydF4y2Ba

我们可以通过对期望的近似计算来进一步增加可处理性gydF4y2Baφ\ (q_ \ \)gydF4y2Ba.我们通过取蒙特卡罗样本gydF4y2Baφ\ (q_ \ \)gydF4y2Ba用这个样本求期望。通过取多个样本并平均期望,可以使这种近似更加精确,但在我们的工作中,我们只使用了一个样本。这样,我们就达到了我们的最终目标,它可以通过任何梯度下降算法进行优化。gydF4y2Ba

数据和材料的可用性gydF4y2Ba

用于我们分析的CC-CCII数据集可以在gydF4y2Bahttp://ncov-ai.big.ac.cn/download?lang=engydF4y2Ba.实现StitchNet和复制我们的结果所需的所有代码都可以在gydF4y2Bahttps://github.com/JudahZammit/stitchnetgydF4y2Ba.gydF4y2Ba

缩写gydF4y2Ba

- COVID-19:gydF4y2Ba

-

2019冠状病毒病gydF4y2Ba

- CT:gydF4y2Ba

-

计算机断层扫描gydF4y2Ba

- SVAE:gydF4y2Ba

-

共享变分自动编码器gydF4y2Ba

- LVAE:gydF4y2Ba

-

阶梯变分自动编码器gydF4y2Ba

- VAE:gydF4y2Ba

-

变分autoencodergydF4y2Ba

- CC-CCII:gydF4y2Ba

-

中国胸部CT图像研究会gydF4y2Ba

- CP:gydF4y2Ba

-

常见的肺炎gydF4y2Ba

- 大会党:gydF4y2Ba

-

冠肺炎gydF4y2Ba

参考文献gydF4y2Ba

...李张K,刘X,沈J, Z,唱Y,吴X, Y咋,梁W,王C,王K, L, M,周Z,李,王J,杨Z, Cai H,徐J,杨L, Cai W,徐W,吴年代,张W,江年代,郑L,张X,王L, L,李J,阴H,王W,李啊,张C,梁L,吴T,邓R,魏K,周Y,陈T,刘JYN,霍英东M,他J,林T,李W,王g .临床准确诊断适用的AI系统,定量测量,并使用计算机断层扫描COVID-19肺炎预后。细胞。2020;181(6):1423 - 143311。gydF4y2Bahttps://doi.org/10.1016/j.cell.2020.04.045gydF4y2Ba.gydF4y2Ba

单峰,高原,王娟,史伟,石楠,韩敏,薛铮,沈东,石勇。基于深度学习的新型冠状病毒肺炎患者胸部CT图像异常肺量化及其在严重程度预测中的应用。中华医学杂志,2021;48(4):1633-45。gydF4y2Bahttps://doi.org/10.1002/mp.14609gydF4y2Ba

范德平,周涛,季国平,周勇,陈刚,傅华,沈娟,邵林。infnet:基于CT图像的新型冠状病毒肺炎肺部感染自动分割。医学影像学报。2020;39(8):2626-37。gydF4y2Bahttps://doi.org/10.1109/TMI.2020.2996645gydF4y2Ba

Ronneberger O, Fischer P, Brox T. U-Net:卷积网络用于生物医学图像分割。在:医学图像计算和计算机辅助干预国际会议(MICCAI)。施普林格;2015.234 - 41页。gydF4y2Ba

Badrinarayanan V, Kendall A, Cipolla R. SegNet:用于图像分割的深度卷积编码器-解码器架构。电子学报。2017;39(12):2481-95。gydF4y2Bahttps://doi.org/10.1109/TPAMI.2016.2644615gydF4y2Ba.gydF4y2Ba

Sandler M, Howard A, Zhu M, Zhmoginov A,陈立昌。MobileNetV2:倒残差和线性瓶颈。见:IEEE计算机视觉和模式识别(CVPR)会议论文集。2018.4510 - 20页gydF4y2Ba

陈丽春,朱勇,陈丽春,陈丽春。基于atrous可分离卷积的图像语义分割算法。见:欧洲计算机视觉会议记录(ECCV)。2018.801 - 18页gydF4y2Ba

陈霞,姚林,张艳。剩余注意力u-net用于COVID-19胸部CT图像自动多类分割。arXiv预印本。gydF4y2BaarXiv: 2004.05645gydF4y2Ba.2020.gydF4y2Ba

王晓明,王晓明,王晓明,等。基于无监督和半监督模糊聚类方法的MR脑图像分割。在:数字图像计算:技术和应用国际会议(DICTA)。IEEE;2016.631 - 7页。gydF4y2Ba

孟达尔,阿加瓦尔,杜尔兹,戴罗希尔。半监督分割的循环算法。arXiv预印本。gydF4y2BaarXiv: 1908.11569gydF4y2Ba.2019.gydF4y2Ba

Bai W, Oktay O, Sinclair M, Suzuki H, Rajchl M, Tarroni G, Glocker B, King A, Matthews PM, Rueckert D.基于网络的心脏MR图像分割的半监督学习。在:医学图像计算和计算机辅助干预国际会议(MICCAI)。施普林格;2017.253 - 60页。gydF4y2Ba

Radosavovic I, Dollár P, Girshick R, Gkioxari G, He K.数据蒸馏:面向全监督学习。见:IEEE计算机视觉和模式识别(CVPR)会议论文集。2018.4119 - 28页。gydF4y2Ba

张勇,杨林,陈杰,Fredericksen M, Hughes DP,陈德泽。利用无注释图像进行生物医学图像分割的深度对抗网络。在:医学图像计算和计算机辅助干预国际会议(MICCAI)。施普林格;2017.408 - 16页。gydF4y2Ba

Baur C, Albarqouni S, Navab N.半监督深度学习的全卷积网络。在:医学图像计算和计算机辅助干预国际会议(MICCAI)。施普林格;2017.311 - 19页。gydF4y2Ba

Kalluri T, Varma G, Chandraker M, Jawahar C.通用半监督语义分割。见:IEEE计算机视觉国际会议论文集(ICCV)。2019.p . 5259 - 70。gydF4y2Ba

米塔尔,Tatarchenko M, Brox T.半监督语义分割的高低一致性。IEEE Trans Pattern Anal Mach intel, 2019; 43:1369-79。gydF4y2Ba

彭杰,Estrada G, Pedersoli M, Desrosiers C.半监督图像分割的深度联合训练。模式识别。2020;107:107269。gydF4y2Ba

洪卫东,蔡永华,刘天佑,林青云,杨明明。半监督语义分割的对抗性学习。见:第29届英国机器视觉会议(BMVC) 2018,第65:1-65:12页gydF4y2Ba

苏利,孙晓明。基于生成对抗网络的半监督语义分割算法。见:IEEE计算机视觉国际会议文集(ICCV) 2017,第5688-96页gydF4y2Ba

李d - h。伪标签:一种简单有效的深度神经网络半监督学习方法。在:ICML 2013研讨会:表征学习的挑战(WREPL)。2013.gydF4y2Ba

冯dlx,刘强,Zammit J, Leung CK-S,胡萍。基于自监督深度学习模型的COVID-19肺部CT图像分割,突出年龄、基础疾病与COVID-19之间的假定因果关系。中华医学杂志2021;19(1):318。gydF4y2Bahttps://doi.org/10.1186/s12967-021-02992-2gydF4y2Ba.gydF4y2Ba

金玛DP, Mohamed S, Jimenez Rezende D, Welling M.基于深度生成模型的半监督学习。In: Ghahramani Z, Welling M, Cortes C, Lawrence N, Weinberger KQ,编辑。神经信息处理系统(NIPS)进展,第27卷。红钩区:Curran Associates Inc.;2014,第3581-9页gydF4y2Ba

Maaløe L, Sønderby CK, Sønderby SK, Winther O.辅助深度生成模型。进:Balcan MF, Weinberger KQ,编辑。第33届机器学习国际会议论文集。机器学习研究论文集,第48卷。PMLR,纽约;2016.1445 - 53页gydF4y2Ba

王晓明,王晓明。自编码变分贝叶斯。在:第二届国际学习陈述会议(ICLR 2014)会议轨道会议记录。gydF4y2BaarXiv: 1312.6114gydF4y2Ba.gydF4y2Ba

李志强,李志强。深度生成模型的随机反向传播和近似推理。入:邢EP, Jebara T,编辑。机器学习研究论文集,第32卷。PMLR,北京;2014.p . 1278 - 86。gydF4y2Bahttp://proceedings.mlr.press/v32/rezende14.htmlgydF4y2Ba.gydF4y2Ba

Sønderby CK, Raiko T, Maaløe L, Sønderby SK, Winther O. Ladder变分自编码器。见:神经信息处理系统进展(NIPS) 2016, p. 3738-46。gydF4y2Ba

Simonyan K, Zisserman A.用于大规模图像识别的深度卷积网络。In:第三届国际学习陈述会议,ICLR 2015年会议跟踪会议记录。gydF4y2Bahttps://doi.org/10.48550/arxiv.1409.1556gydF4y2Ba.gydF4y2Ba

Sandler M, Howard A, Zhu M, Zhmoginov A,陈立昌。MobileNetV2:倒残差和线性瓶颈。见:IEEE计算机视觉和模式识别(CVPR)会议论文集。2018,第4510-20页gydF4y2Ba

Ioffe S, Szegedy C.批归一化:通过减少内部协变量移位加速深度网络训练。在:巴赫F, Blei D,编辑。第32届机器学习国际会议论文集。机器学习研究论文集,第37卷。里尔,PMLR, 2015。448 - 56页。gydF4y2Bahttp://proceedings.mlr.press/v37/ioffe15.htmlgydF4y2Ba.gydF4y2Ba

Nair V, Hinton GE。整流线性单元改进了受限玻尔兹曼机。见:第27届机器学习国际会议论文集。ICML 10。麦迪逊:Omnipress, 2010年。807 - 14页。gydF4y2Ba

金马平,巴建林。一个随机优化的方法。在:第三届国际学习陈述会议,ICLR 2015年会议轨道会议记录。gydF4y2BaarXiv: 1412.6980gydF4y2Ba.gydF4y2Ba

确认gydF4y2Ba

我们非常感谢王光宇博士创建并公开提供高质量的CC-CCII数据集。gydF4y2Ba

关于这个补充剂gydF4y2Ba

本文已作为BMC生物信息学第23卷第7补编的一部分发表,第20届亚太生物信息学会议(APBC 2022):生物信息学。该补充的全部内容可在网上查阅gydF4y2Bahttps://bmcbioinformatics.biomedcentral.com/articles/supplements/volume-23-supplement-7gydF4y2Ba.gydF4y2Ba

资金gydF4y2Ba

不适用。gydF4y2Ba

作者信息gydF4y2Ba

作者及隶属关系gydF4y2Ba

贡献gydF4y2Ba

JZ:设计并实现算法,撰写稿件;DLXF、QL:进行数据分析,参与算法设计;CK-SL和PH监督项目并修改手稿。所有作者都阅读并批准了手稿。gydF4y2Ba

相应的作者gydF4y2Ba

道德声明gydF4y2Ba

伦理批准并同意参与gydF4y2Ba

不适用。gydF4y2Ba

发表同意书gydF4y2Ba

不适用。gydF4y2Ba

相互竞争的利益gydF4y2Ba

作者宣称他们之间没有利益冲突。gydF4y2Ba

额外的信息gydF4y2Ba

出版商的注意gydF4y2Ba

伟德体育在线施普林格自然对出版的地图和机构从属关系中的管辖权主张保持中立。gydF4y2Ba

补充信息gydF4y2Ba

附加文件1gydF4y2Ba

:gydF4y2Ba表S1gydF4y2Ba.所选超参数用于训练StitchNet。gydF4y2Ba表S2gydF4y2Ba.验证数据集上磨玻璃不透明度(GGO)、固结(CON)、背景和总体平均值的定量结果。gydF4y2Ba表S3gydF4y2Ba.磨玻璃不透明度(GGO)、巩固(CON)、背景和训练数据集的总体平均值的定量结果。gydF4y2Ba

权利和权限gydF4y2Ba

开放获取gydF4y2Ba本文遵循知识共享署名4.0国际许可协议,允许以任何媒介或格式使用、分享、改编、分发和复制,只要您对原作者和来源给予适当的署名,提供知识共享许可协议的链接,并注明是否有更改。本文中的图像或其他第三方材料包含在文章的创作共用许可协议中,除非在材料的信用额度中另有说明。如果材料未包含在文章的创作共用许可协议中,并且您的预期使用不被法定法规所允许或超出了允许的使用范围,您将需要直接获得版权所有者的许可。如欲查看本牌照的副本,请浏览gydF4y2Bahttp://creativecommons.org/licenses/by/4.0/gydF4y2Ba.创作共用公共领域奉献弃权书(gydF4y2Bahttp://creativecommons.org/publicdomain/zero/1.0/gydF4y2Ba)适用于本条所提供的资料,除非在资料的信用额度中另有说明。gydF4y2Ba

关于本文gydF4y2Ba

引用本文gydF4y2Ba

蔡国强,冯国强,刘志强。gydF4y2Baet al。gydF4y2Ba基于深度生成模型的半监督COVID-19 CT图像分割。gydF4y2BaBMC生物信息学gydF4y2Ba23gydF4y2Ba(增刊7),343(2022)。https://doi.org/10.1186/s12859-022-04878-6gydF4y2Ba

收到了gydF4y2Ba:gydF4y2Ba

接受gydF4y2Ba:gydF4y2Ba

发表gydF4y2Ba:gydF4y2Ba

DOIgydF4y2Ba:gydF4y2Bahttps://doi.org/10.1186/s12859-022-04878-6gydF4y2Ba

关键字gydF4y2Ba

- Semi-supervised学习gydF4y2Ba

- 卷积网络gydF4y2Ba

- 图像分割gydF4y2Ba

- 新型冠状病毒肺炎gydF4y2Ba

- 计算机断层扫描gydF4y2Ba